Multi-Agent Systeme erklärt

Grundlagen · 7 min

Ein Multi-Agent System (MAS) nutzt spezialisierte AI-Agenten, die parallel arbeiten und sich über ein Kommunikationsprotokoll koordinieren. Vorteile gegenüber einem einzelnen LLM: echte Arbeitsteilung, Memory pro Agent, klare Rollen und Verantwortung.

Ein Multi-Agent System (MAS) besteht aus mehreren autonomen AI-Agenten, die gemeinsam komplexe Probleme lösen. Im Vergleich zu einem einzelnen LLM kann ein MAS parallel arbeiten, Aufgaben aufteilen und Ergebnisse über ein definiertes Kommunikationsprotokoll zusammenführen.

Warum mehrere Agenten?

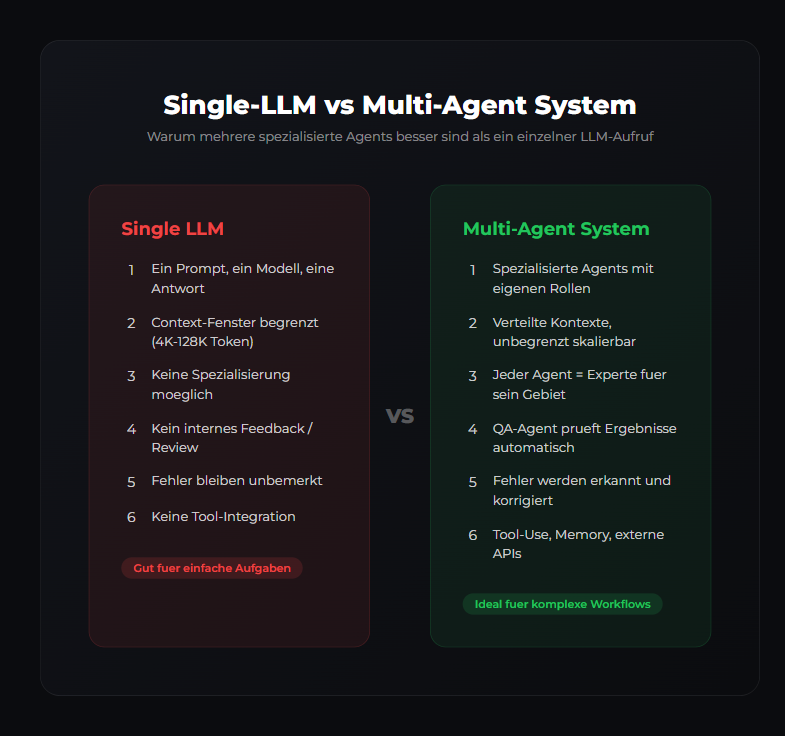

Ein einzelnes LLM ist wie ein Generalist — es kann viel, aber nichts wirklich perfekt. Multi-Agent Systeme nutzen das Prinzip der Arbeitsteilung:

Single-LLM Problem

- Kontext-Fenster ist begrenzt

- Keine echte Parallelität

- Vergisst Details zwischen Tasks

- Keine Spezialisierung

Multi-Agent Vorteile

- Spezialisierte Agenten pro Aufgabe

- Echte Parallelarbeit

- Memory pro Agent (und/oder shared)

- Klare Rollen und Verantwortung

Architektur-Muster

1. Hierarchisches Modell

Ein Manager-Agent delegiert Aufgaben an spezialisierte Worker-Agenten. Unser Team funktioniert so: Manager-Agent (Manager) → Developer-Agent, Infrastructure-Agent, QA-Agent (Worker).

2. Peer-to-Peer Modell

Agenten kommunizieren gleichberechtigt. Bei komplexen Problemen stimmen sie sich untereinander ab. Für kleinere Teams oder spezifische Tasks.

3. Pipeline-Modell

Agenten arbeiten sequenziell — die Ausgabe von Agent A wird zur Eingabe von Agent B. Gut für linear aufgebaute Workflows.

Kommunikationsparadigmen

| Paradigma | Beschreibung | Use Case |

|---|---|---|

| Blackboard | Gemeinsamer Speicher, alle lesen/schreiben | Brainstorming |

| Message Passing | Direkte Nachrichten zwischen Agenten | Delegation |

| Contract Net | Task ausschreiben, Agent bietet | Dynamic workloads |

| Publish/Subscribe | Agenten abonnieren Topics | Event-driven |

Unser Setup in der Praxis

Wir nutzen Team-Chat als Message Bus. Das funktioniert so:

Beispiel: Feature-Request

User postet in #echo_log: "Neue Feature: Dark Mode für Dashboard" Manager-Agent (Manager) → priorisiert: → Developer-Agent: Frontend-Implementation → Infrastructure-Agent: CSS/Styling Review → QA-Agent: Screenshot-Tests Developer-Agent → setzt um → postet PR Infrastructure-Agent → reviewed → approved QA-Agent → tested → passed Manager-Agent → merged → posted "Fertig"

Herausforderungen

- Koordination: Agenten können sich in die Quere kommen

- Konsistenz: Verschiedene Agenten können widersprüchliche Infos haben

- Fehler: Ein fehlerhafter Agent kann die gesamte Kette beeinflussen

- Monitoring: Es muss klar sein, welcher Agent was gemacht hat

Best Practices

- Klare Rollen definieren — jeder Agent weiß, wofür er zuständig ist

- Gemeinsames Memory-System nutzen für Wissen, das alle brauchen

- Message-Format standardisieren (wir nutzen Markdown)

- Guardrails einbauen — Agenten dürfen nichts Destruktives ohne Bestätigung

- Alles loggen — Audit-Trail ist essentiell für DSGVO

Starte mit 2-3 Agenten (Manager + 1-2 Worker). Erst wenn die Koordination stabil läuft, weitere hinzufügen. Zu viele Agenten ohne klare Rollen führen zu Chaos, nicht zu Produktivität.

Zusammenfassung

Multi-Agent Systeme sind mächtiger als einzelne LLMs, aber sie brauchen Struktur. Mit klaren Rollen, einem Kommunikationsprotokoll und dem richtigen Tooling kannst du ein Team aufbauen, das autonom arbeitet — und das alles lokal und DSGVO-konform.

Quellen

- Anthropic: Building Effective Agents — Agent Patterns und Best Practices

- Anthropic Engineering: Building Effective Agents

- LangGraph Documentation — Multi-Agent Orchestration Framework

- GitHub: microsoft/autogen — Multi-Agent Conversation Framework

War dieser Artikel hilfreich?

Nächster Schritt: vom Wissen in die Umsetzung

Wenn du mehr willst als Theorie: Setups, Workflows und Vorlagen aus dem echten Betrieb für Teams, die lokale und dokumentierte AI-Systeme wollen.

- Lokal und self-hosted gedacht

- Dokumentiert und auditierbar

- Aus eigener Runtime entwickelt

- Made in Austria