Lokale AI vs. Cloud: Der TCO-Vergleich

Grundlagen · 8 min

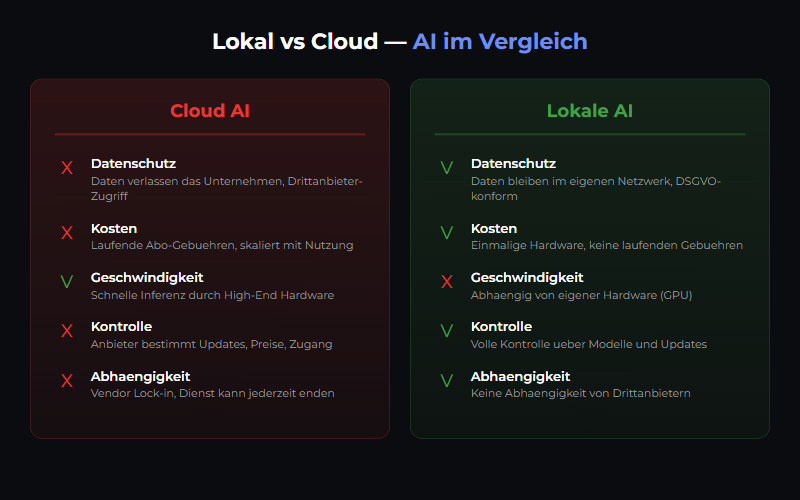

Cloud AI wirkt günstig — kein Hardware-Kauf, keine Wartung, einfach loslegen. Aber die versteckten Kosten summieren sich. Hier ist unser Vergleich, basierend auf echter Nutzung.

Hinweis: Dies ist unser Vergleich für den Use Case "laufend AI-Agent für Business-Automation". Für einmalige Analysen oder Prototypen kann Cloud günstiger sein.

Die Szenarien

Cloud-Nutzung

Täglich 100 API-Calls an OpenAI/Gemini/Claude für Workflow-Automation, Support-Chatbot und Content-Generierung.

Lokaler Stack

Ollama auf eigener Hardware (RTX 3090), n8n für Automation, self-hosted Monitoring. Alles läuft 24/7.

Kostenvergleich (pro Monat)

| Kostenpunkt | Cloud | Lokal | Differenz |

|---|---|---|---|

| API-Kosten | €150-300 | €0 | -€150-300 |

| Hardware/Amortisation | €0 | €25-50 | +€25-50 |

| Strom (geschätzt) | €0 | €20-40 | +€20-40 |

| Hosting/Server | €0 | €10-20 | +€10-20 |

| Monitoring/Tools | €20-50 | €0* | -€20-50 |

| DSGVO-Compliance | €50-200 | €0 | -€50-200 |

| Summe/Monat | €220-550 | €55-110 | -€165-440 |

*Grafana + Prometheus sind Open Source, kostenlos

Die versteckten Cloud-Kosten

- API-Kosten eskalieren — Je mehr Workflows du automatisierst, desto mehr Calls. Oft 2-3x höher als initial geplant.

- Drittlandtransfer pruefen — Bei US-Anbietern greift Art. 44 ff. DSGVO. Zusaetzliche Massnahmen (SCCs, TIAs) sind erforderlich. Rechtsberatung empfohlen.

- Vendor Lock-in — Deine Prompts, Workflows, Daten sind beim Anbieter. Umsteigen ist teuer und zeitaufwendig.

- Rate Limits — Cloud-Anbieter drosseln bei viel Nutzung. Business-Pläne kosten wieder extra.

- Datenschutz-Vorfälle — Jeder Datenleck ist dein Problem. Lokale Systeme = weniger Risiko.

Wann Cloud günstiger ist

| Use Case | Empfehlung |

|---|---|

| Prototyp (wenige Calls/Monat) | Cloud — kein Setup nötig |

| Einmalige Analysen | Cloud — pay-as-you-go |

| Kein Budget für Hardware | Cloud starten, später umsteigen |

| Wenige interne Tools | Cloud — Overscale für little use |

| Laufende Automation (unser Use Case) | Lokal — ab 6 Monaten günstiger |

Break-Even Analyse (ehrlich)

Wann lohnt sich der Umstieg auf lokal? Das hängt stark von deiner Nutzung ab.

TCO Faustregel (Consumer Hardware, Österreich): Hardware (einmalig): RTX 3090 gebraucht: ~EUR 900 System (CPU, RAM, NVMe): EUR 500-800 Laufende Kosten (50% Last, 24/7): Strom: ~EUR 49/Monat → ~EUR 588/Jahr Gesamt Jahr 1: ~EUR 2.000-2.300 Gesamt ab Jahr 2: ~EUR 588/Jahr Break-Even vs. Cloud API: Laut DevTk.AI/Prem AI: erst ab 50M-200M Tokens/Monat Unter 2M Tokens/Tag: API ist günstiger Hidden Cost Faktor: TCO wird 3-5x unterschätzt (AISuperior) Engineering-Anteil: 45-55% des TCO (AISuperior) Cloud API Preise (März 2026, pro 1M Tokens): GPT-4o: $2.50 Input / $10.00 Output Claude Sonnet 4.5: $3.00 Input / $15.00 Output Gemini 2.5 Pro: $1.25 Input / $10.00 Output GPT-4o-mini: $0.15 Input / $0.60 Output

Der Break-Even für Self-Hosting liegt bei 50-200 Millionen Tokens pro Monat. Unter 2M Tokens/Tag ist die Cloud API günstiger. Der finanzielle Vorteil von lokal wird oft überschätzt — der echte Vorteil liegt bei Datenschutz (DSGVO), Verfügbarkeit (offline) und Unabhängigkeit von Anbietern.

Hardware-Kosten (ehrlich)

| GPU | VRAM | Preis (EUR) | Was läuft darauf | Einschränkung |

|---|---|---|---|---|

| RTX 3060 12GB | 12 GB | ~350 | 7B Modelle (Mistral 7B, Llama 3.2 8B) | NUR kleine Modelle, für 14B+ zu wenig VRAM |

| RTX 4070 Ti Super | 16 GB | ~800 | Bis 14B komfortabel (Qwen 2.5 14B) | 32B nur stark quantisiert, 70B unmöglich |

| RTX 3090 (gebraucht) | 24 GB | 750-1.123 | Bis 34B quantisiert (Q4_K_M) | 70B passt NICHT (braucht ~40 GB VRAM) |

| RTX 4090 | 24 GB | 1.800-2.000 | Bis 34B komfortabel | Gleiche 24 GB VRAM-Grenze wie RTX 3090 |

Inference Speed (RTX 3090, echte Messwerte)

| Modell | Parameter | tok/s (RTX 3090) | Quelle |

|---|---|---|---|

| 8B Modelle (allgemein) | 8B | ~112 | CoreLab |

| GLM 7.8B | 7.8B | 90.1 | LocalAIMaster |

| DeepSeek-R1 14B | 14B | 56.6 | LocalAIMaster |

| Qwen3 14B | 14B | 43.2 | LocalAIMaster |

| RTX 3090 Durchschnitt | — | ~42 | LocalAIMaster |

Stromkosten (ehrlich)

"Kostenlos nach Anschaffung" ist falsch. GPUs brauchen Strom, und der kostet in Österreich EUR 0,34/kWh (Privat, inkl. Steuern, Stand 2026). Hier die echten Zahlen bei 24/7 Betrieb:

| Szenario (RTX 3090) | Watt | kWh/Monat | EUR/Monat (AT) | EUR/Jahr |

|---|---|---|---|---|

| GPU Volllast (350W TDP) | 350 | 252 | EUR 85,68 | EUR 1.028 |

| System gesamt (~450W) | 450 | 324 | EUR 110,16 | EUR 1.322 |

| GPU Idle (~18W) | 18 | 13 | EUR 4,42 | EUR 53 |

| Realistisch (50% Last, 24/7) | ~200 | 144 | EUR 48,96 | EUR 588 |

Bei realistischem Betrieb (50% Last, 24/7) einer RTX 3090 zahlst du ca. EUR 49/Monat Strom in Österreich. Das sind ~EUR 588/Jahr. Peak-Verbrauch kann bis 560W gehen (60% über TDP). Strompreis AT Privat: EUR 0,34/kWh (EU-Durchschnitt: EUR 0,258).

Die Qualitätslücke (ehrlich)

Lokale Modelle sind gut — aber nicht so gut wie die besten Cloud-Modelle. Hier der ehrliche Vergleich:

| Task | GPT-4o (Cloud) | Llama 3.3 70B (Lokal) |

|---|---|---|

| Reasoning / Logik | 69% | 44% |

| Klassifikation | 73% | 70% |

| Code Generation | Sehr gut | ~85-90% der Cloud-Qualität |

| Einfache Extraktion | Exzellent | ~95% gleichwertig |

Vor allem bei komplexem Reasoning (logische Schlüsse, mehrstufige Analyse, juristische Argumentation) liegt Cloud deutlich vorne. Wer behauptet lokale Modelle seien "fast gleichwertig" verschweigt diesen Unterschied.

Für 80% der alltäglichen Tasks (Daten-Extraktion, Klassifikation, einfache Q&A, Zusammenfassungen) sind lokale Modelle ausreichend. Für komplexes Reasoning: Cloud-API als Backup.

Unsere Empfehlung

Hybrid-Ansatz (unser Setup)

- Lokal: Ollama für regelmäßige Tasks (Extraktion, Klassifikation, einfache Q&A)

- Cloud: GPT-4o / Claude für komplexe Reasoning-Tasks (wenige Calls/Monat)

- Kosten: ~EUR 49/Monat Strom (AT, 50% Last) + EUR 20-40/Monat Cloud-API

- Ergebnis: Guter Kompromiss aus Kosten, Qualität und Datenschutz

Fazit

Lokal ist nach 6-12 Monaten günstiger — BEI regelmäßiger Nutzung. Bei geringer Nutzung ist Cloud finanziell besser. Die Qualität ist für 80% der Tasks ausreichend, für komplexes Reasoning braucht man Cloud-APIs als Ergänzung. Der EHRLICHSTE Ansatz ist Hybrid: lokal wo es reicht, Cloud wo es zählt. Dazu kommen die DSGVO-Vorteile (kein Drittlandtransfer) und die Unabhängigkeit von Cloud-Anbietern.

Quellen

- GlobalPetrolPrices: Austria Electricity 2026 — Strompreis AT Privat EUR 0,34/kWh

- BestValueGPU: RTX 3090 Preisentwicklung — Gebrauchtpreise EUR 750-1.123

- XDA Developers: RTX 3090 Value King 2026 — RTX 3090 als bestes Preis-Leistungs-Verhältnis

- DevTk.AI: Self-Hosting vs API Cost 2026 — Break-Even bei 50M-200M Tokens/Monat

- Prem AI: Self-Hosted LLM Guide 2026 — Unter 2M Tokens/Tag ist API günstiger

- AISuperior: LLM Deployment Cost — Hidden Cost Faktor 3-5x, Engineering 45-55%

- OpenAI Pricing — GPT-4o $2.50/$10 pro 1M Tokens

- Anthropic Pricing — Claude Sonnet $3/$15 pro 1M Tokens

- Google Gemini Pricing — Gemini 2.5 Pro $1.25/$10 pro 1M Tokens

- LocalAIMaster: Best GPUs for AI — Inference Speed RTX 3090 (tok/s)

- CoreLab: LLM GPU Benchmarks — 8B ~112 tok/s auf RTX 3090

- IntuitionLabs: 24GB GPU Optimization — Max ~34B auf 24 GB VRAM

- NotebookCheck: RTX 3090 Power — TDP 350W, Peak bis 560W

War dieser Artikel hilfreich?

Nächster Schritt: vom Wissen in die Umsetzung

Wenn du mehr willst als Theorie: Setups, Workflows und Vorlagen aus dem echten Betrieb für Teams, die lokale und dokumentierte AI-Systeme wollen.

- Lokal und self-hosted gedacht

- Dokumentiert und auditierbar

- Aus eigener Runtime entwickelt

- Made in Austria