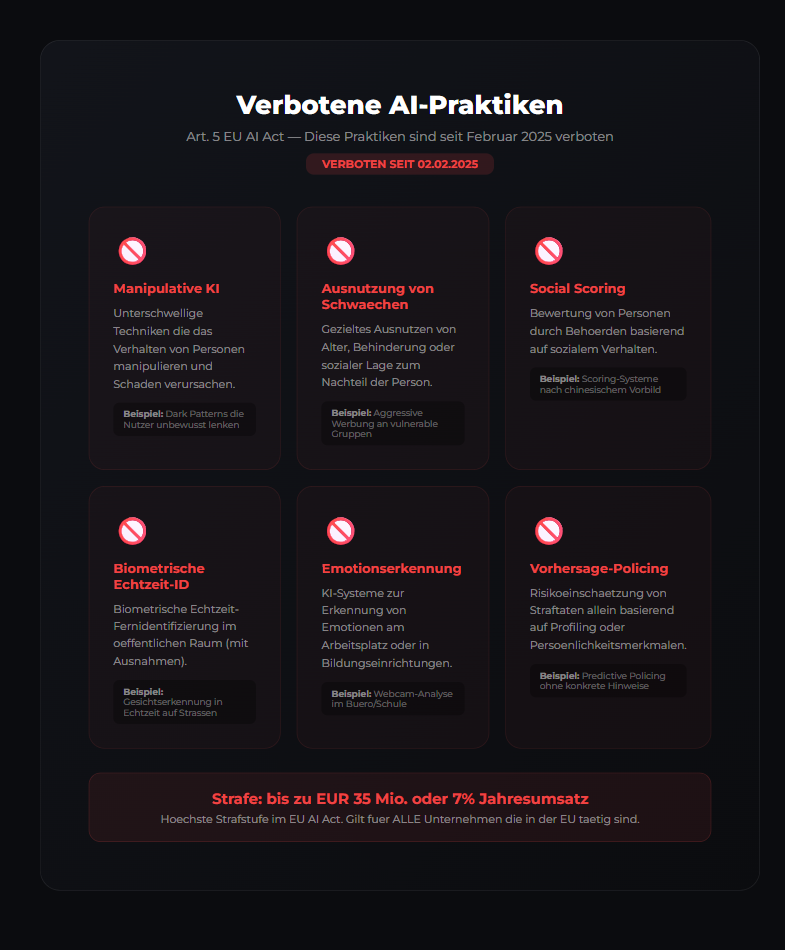

Verbotene AI-Praktiken

Compliance · 4 min · Stand: Feb 2026

Achtung: Seit 2. Februar 2025 in Kraft

Article 5 des EU AI Act verbietet bestimmte KI-Praktiken absolut. Keine Abwägung, keine Ausnahmen — absolute Verbote mit Strafen bis zu €35 Mio.

Die 6 verbotenen Praktiken

1. Subversive Manipulation (Art. 5(1)(a))

Was verboten ist: KI-Systeme, die Menschen durch "subliminale Techniken" oder bewusste Täuschung zu schädlichen Entscheidungen bringen.

Beispiel: Ein KI-Tool, dasimpulsives Kaufverhalten durch versteckte Trigger manipuliert.

2. Social Scoring (Art. 5(1)(b))

Was verboten ist: KI-Systeme, die Personen basierend auf ihrem sozialen Verhalten oder nicht rechtlich begründeten Kriterien bewerten.

Beispiel: Ein System, das Bonität basierend auf Social-Media-Aktivität bewertet.

3. Biometrische Kategorisierung (Art. 5(1)(c))

Was verboten ist: Nutzung biometrischer Daten zur Kategorisierung von Personen in Echtzeit an öffentlichen Orten.

Beispiel: Gesichtserkennung in Echtzeit auf öffentlichen Plätzen zur Erkennung von "auffälligem Verhalten".

4. Emotion Recognition im Arbeitskontext (Art. 5(1)(d))

Was verboten ist: KI-Systeme zur Erkennung von Emotionen am Arbeitsplatz und in Bildungseinrichtungen.

Beispiel: Webcam-Analyse während Bewerbungsgespräche zur Bewertung von "Vertrauen" oder "Nervosität".

5. Ungezielte Gesichtsdaten-Sammlung (Art. 5(1)(e))

Was verboten ist: Erstellen oder Erweitern von Datenbanken durch ungezieltes Sammeln von Gesichtsbildern aus dem Internet.

Beispiel: Scraping von Social-Media-Profilen zur Erstellung von Face-Recognition-Datenbanken.

6. Behördliche Social Scoring Systeme (Art. 5(1)(f))

Was verboten ist: KI-Systeme von Behörden, die Bürger basierend auf sozialem Verhalten risiko-bewerten.

Beispiel: Automatisierte Entscheidungen über Sozialleistungen basierend auf "Risiko-Scores".

Ausnahmen

Bestimmte biometrische Anwendungen sind erlaubt:

- Gesichtserkennung für Strafverfolgung (mit Genehmigung)

- Notfall-Suchen (Vermisste, Terrorismus)

- Medizinische Anwendungen

- Sicherheit kritischer Infrastruktur

Was Unternehmen jetzt tun müssen

- Alle KI-Systeme auf verbotene Praktiken prüfen

- Dokumentation vorhandener Systeme aktualisieren

- Verträge mit KI-Anbietern prüfen

- Interne Richtlinien für erlaubte KI-Nutzung erstellen

Prüfe dein System

# Checkliste: Ist dein System verboten?

## Frage 1: Manipuliert das System Menschen?

→subliminale Techniken, versteckte Trigger

→ VERBOTEN wenn JA

## Frage 2: Bewertet das System Personen nach sozialem Verhalten?

→ Social Scoring, Bonität aus Social Media

→ VERBOTEN wenn JA

## Frage 3: Nutzt das System biometrische Daten in Echtzeit?

→ Gesichtserkennung auf öffentlichen Plätzen

→ VERBOTEN wenn JA (Ausnahmen s.o.)

## Frage 4: Erkennt das System Emotionen am Arbeitsplatz?

→ Webcam-Analyse, Stimmungsanalyse

→ VERBOTEN wenn JA

## Frage 5: Sammelt das System ungezielt Gesichtsbilder?

→ Scraping aus dem Internet

→ VERBOTEN wenn JAQuellen

Weiterfuehrende Artikel: EU AI Act · EU AI Act Checkliste · DSGVO Grundlagen

Fuer die Umsetzung gibt es Ressourcen auf ai-engineering.at.

War dieser Artikel hilfreich?

Nächster Schritt: Compliance in den Betrieb bringen

Nutze fertige DSGVO-Templates, Checklisten und Praxis-Guides für AI-Systeme, die dokumentiert und auditierbar sein müssen.

- Lokal und self-hosted gedacht

- Dokumentiert und auditierbar

- Aus eigener Runtime entwickelt

- Made in Austria