EU AI Act: Was du wissen musst

Compliance · 10 min

Der EU AI Act (Verordnung 2024/1689) ist der weltweit erste umfassende Rechtsrahmen für Künstliche Intelligenz. Er klassifiziert AI-Systeme nach Risiko und definiert Pflichten für Anbieter und Betreiber. Für die meisten Self-Hosted AI-Setups gilt: Minimal Risk, keine besonderen Pflichten — aber Transparenz und Dokumentation sind trotzdem empfohlen.

Der EU AI Act (Verordnung 2024/1689) wurde am 12. Juli 2024 im EU-Amtsblatt veröffentlicht und ist am 1. August 2024 in Kraft getreten. Er ist der umfassendste Regelungsrahmen der EU für Künstliche Intelligenz. Einige Pflichten — wie die Verbote (Art. 5) und die KI-Kompetenz (Art. 4) — gelten bereits seit 2. Februar 2025. Die vollständige Anwendung mit Enforcement und Strafen startet ab 2. August 2026.

Die Pflicht zur KI-Kompetenz (Art. 4) gilt seit 2. Februar 2025. Es gibt keine Einheitszertifizierung, keine Pflicht zu einem AI Officer und keine One-size-fits-all-Schulung. Die Überwachung und Durchsetzung (Enforcement) startet ab August 2026.

Bis zu 35 Millionen Euro oder 6% des globalen Jahresumsatzes sind möglich. Für KMU gelten etwas mildere Regeln, aber die Pflichten bleiben.

Was regelt der EU AI Act?

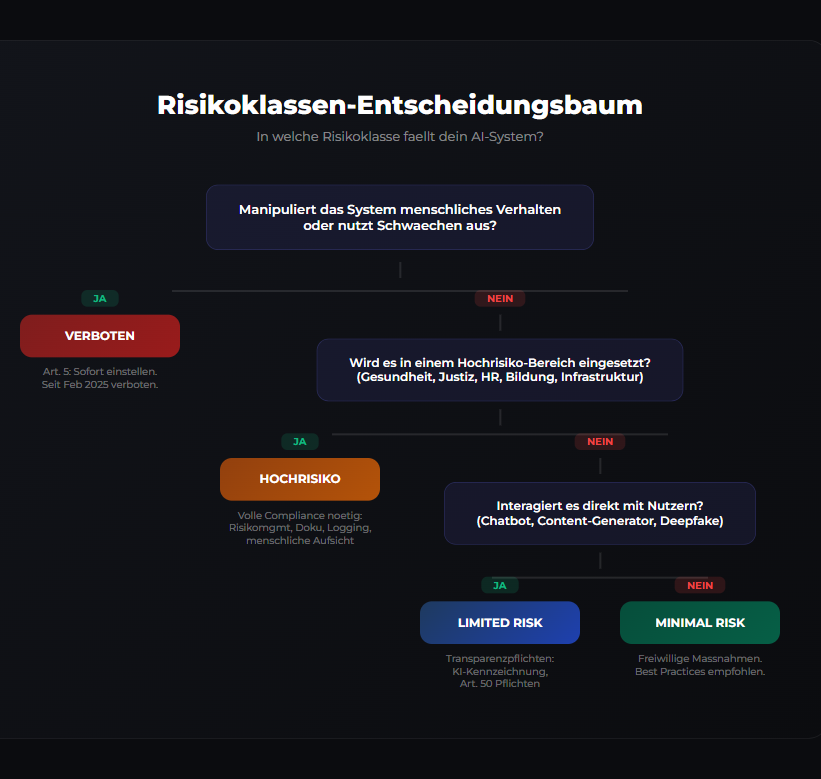

Der AI Act reguliert AI-Systeme basierend auf ihrem Risikopotenzial:

Unacceptable Risk

Systeme, die Menschen manipulieren, soziales Scoring betreiben oder biometrische Fernidentifikation in Echtzeit. Komplett verboten.

High Risk

AI in kritischen Bereichen (Gesundheit, Bildung, Beschäftigung, Strafverfolgung). Strenge Anforderungen an Dokumentation, Transparenz, menschliche Aufsicht.

Limited Risk

Chatbots, Deepfakes, Emotionserkennung. Transparenzpflicht — muss klar sein, dass man mit AI interagiert.

Minimal Risk

Spam-Filter, Empfehlungssysteme, Gaming-AI. Keine speziellen Pflichten. Die meisten Homelab-AI-Systeme fallen hierunter.

Was das für typische Business-KI-Nutzung bedeutet

| Szenario | Risikostufe | Pflichten |

|---|---|---|

| LLM für Content-Erstellung | Minimal bis Begrenzt | Transparenz bei Veröffentlichung ohne menschliche Prüfung |

| KI-Kundensupport-Chatbot | Begrenzt | Nutzer müssen wissen, dass sie mit KI sprechen. Bei Entscheidungen über Leistungserbringung evtl. Hochrisiko. |

| Interne Produktivität (E-Mail, Code, Zusammenfassungen) | Minimal | Keine spezifischen Pflichten, aber Dokumentation empfohlen |

| KI für Recruiting (Lebensläufe, Kandidaten-Ranking) | Hoch | Volle Compliance: Doku, Risikomanagement, menschliche Aufsicht |

Für wen gilt der AI Act?

| Akteur | Pflichten |

|---|---|

| AI-Entwickler | Konformitätsbewertung, technische Dokumentation, Qualitätsmanagement |

| Deployer (Nutzer) | Menschliche Aufsicht, Monitoring, Transparenz gegen Betroffene |

| Importeure/Händler | CE-Kennzeichnung, Konformitätserklärung |

Pflichten für High-Risk AI

| Bereich | Pflicht |

|---|---|

| Dokumentation | Detaillierte technische Dokumentation vor Markteinführung: Verwendungszweck, Design, Methodik, Testergebnisse |

| Risikomanagement | Dokumentierter, fortlaufender Prozess zur Identifizierung, Analyse und Minderung von Risiken — kein einmaliges Assessment |

| Data Governance | Trainings- und Testdaten müssen Qualitätskriterien erfüllen. Datenquellen, Aufbereitungsmethoden und potenzielle Verzerrungen dokumentieren |

| Transparenz | Klare Informationen über Fähigkeiten, Einschränkungen und Verwendungszweck. Nutzungsanweisungen bereitstellen |

| Menschliche Aufsicht | Menschen können Fähigkeiten und Grenzen verstehen, in Entscheidungen eingreifen und das System nicht nutzen oder Ergebnisse ignorieren |

| Aufzeichnungspflicht | Automatische Protokollierung des Betriebs zur Nachverfolgbarkeit. Auf Anfrage den Behörden bereitstellen |

| Genauigkeit | Angemessene Genauigkeit, Robustheit, Cybersicherheit |

| Kennzeichnung | CE-Kennzeichnung, EU-Konformitätserklärung |

Timeline: Wann gilt was?

| Datum | Was gilt |

|---|---|

| 12. Juli 2024 | Im EU-Amtsblatt veröffentlicht |

| 01. Aug 2024 | In Kraft getreten |

| 02. Feb 2025 | Verbote (Art. 5) + KI-Kompetenz (Art. 4) gelten BEREITS |

| 02. Aug 2025 | Governance-Regeln + GPAI-Modelle (Transparenz, Copyright) |

| 02. Aug 2026 | Vollständige Anwendung (High-Risk etc.) + Enforcement/Überwachung startet |

| 02. Aug 2027 | Hochrisiko-KI in regulierten Produkten |

Dreistufiges Sanktionssystem

| Verstoss | Maximale Strafe |

|---|---|

| Verbotene KI-Praktiken | 35 Mio. EUR oder 7% des weltweiten Jahresumsatzes |

| Hochrisiko-KI-Anforderungen | 15 Mio. EUR oder 3% des Umsatzes |

| Falsche Angaben gegenüber Behörden | 7,5 Mio. EUR oder 1% des Umsatzes |

Für kleine und mittlere Unternehmen werden die Bussgelder verhältnismässig angepasst, aber sie sind immer noch erheblich genug, um die Existenz eines kleinen Unternehmens zu gefährden.

Was bedeutet das für Self-Hosted AI?

Gute Nachrichten:

- ✅ Die meisten Self-Hosted AI-Nutzungen fallen unter "Minimal Risk"

- ✅ Keine CE-Kennzeichnung nötig

- ✅ Keine Konformitätsbewertung erforderlich

- ✅ Lokale Nutzung = volle Kontrolle = leichtere Compliance

Aber beachten:

- ⚠️ Wenn du AI als Produkt anbietest → andere Regeln

- ⚠️ Automatisierte Entscheidungen mit rechtlicher Wirkung → High Risk

- ⚠️ Biometrische Kategorisierung → verboten oder eingeschränkt

- ⚠️ Chatbot-Nutzung → Transparenzpflicht (Kenntnis geben)

Beispiel: AI-System kategorisieren

# Fragebogen zur Risikokategorisierung

## 1. Systemzweck

Was macht dein AI-System?

→ internen Kundensupport automatisieren

## 2. Entscheidungen mit rechtlicher Wirkung?

Können AI-Entscheidungen rechtliche Folgen haben?

→ Nein, nur Empfehlungen

## 3. Kritischer Bereich?

Gesundheit, Bildung, Beschäftigung, Finanzen?

→ Nein

## 4. Biometrische Daten?

Verarbeitet das System biometrische Daten?

→ Nein

## Ergebnis: MINIMAL RISK ✅

→ Keine speziellen Pflichten nötig

---

# Anders: Recruiting-Tool

## 1. Systemzweck

→ Bewerber screening und Ranking

## 2. Entscheidungen mit rechtlicher Wirkung?

→ Ja, beeinflusst Einstellungen

## 3. Kritischer Bereich?

→ Beschäftigung → HIGH RISK ❌

→ Dokumentation + menschliche Aufsicht nötigCheckliste: Bereitschaft für AI Act

- ☐ Kategorie deiner AI-Nutzung bestimmt (Minimal/Limited/High Risk)

- ☐ Dokumentation, wie AI in deinem Unternehmen genutzt wird

- ☐ Prozess für Transparenz (Nutzer wissen, dass AI im Einsatz)

- ☐ Bei High Risk: Technische Dokumentation vorhanden

- ☐ Menschliche Aufsicht sichergestellt (wer überwacht AI-Entscheidungen?)

- ☐ Bei Chatbots: Transparente Kommunikation ("Du chatst mit einem Bot")

- ☐ Löschkonzept für AI-generierte Daten

- ☐ Regelmäßige Überprüfung der AI-Nutzung

Unsere Empfehlung

- 1. Kategorisiere deine AI-Nutzung (Minimal/Limited/High)

- 2. Dokumentiere alle AI-Systeme (Art. 30 DSGVO + AI Act)

- 3. Transparenz schaffen — Nutzer informieren

- 4. Self-Hosted bevorzugen — volle Kontrolle, leichtere Compliance

- 5. Monitoring — regelmäßig prüfen ob sich was geändert hat

Weiterführend

- • KI-Kompetenz: Art. 4 KI-Kompetenz Pflicht →

- • DSGVO: DSGVO Grundlagen →

- • DPIA: Datenschutz-Folgenabschätzung →

Quellen

- EUR-Lex: Verordnung (EU) 2024/1689 — EU AI Act Volltext

- AI Act Explorer — Interaktive Aufbereitung aller Artikel

- EU-Kommission: Regulatory Framework for AI — Offizielle Übersicht

- RIS — Rechtsinformationssystem des Bundes — Österreichische Umsetzung

- WKO AI-Toolbox — Praktische AI-Tools und Leitfäden der Wirtschaftskammer Österreich

- RTR KI-Servicestelle — Österreichische KI-Servicestelle, Projekte und Initiativen

- FFG — Österreichische Forschungsförderungsgesellschaft — Förderungen für AI-Projekte und Digitalisierung

- caralegal KI-Richtlinie Guide & Vorlage — Praktischer Guide für unternehmenseigene KI-Richtlinien

- EU-Kommission: AI Literacy — Questions and Answers — Offizielle FAQ zu Art. 4 KI-Kompetenz

- WKO AI Act Übersicht — Praxisnahe Übersicht der Wirtschaftskammer Österreich zum EU AI Act für Unternehmen

- EU AI Office — Zentrale Stelle der EU-Kommission für KI-Governance und Durchsetzung

- NIST AI Risk Management Framework — US-amerikanisches Rahmenwerk für KI-Risikomanagement

- OECD.AI Policy Observatory — Internationale KI-Policy-Datenbank und Ländervergleiche

War dieser Artikel hilfreich?

Nächster Schritt: Compliance in den Betrieb bringen

Nutze fertige DSGVO-Templates, Checklisten und Praxis-Guides für AI-Systeme, die dokumentiert und auditierbar sein müssen.

- Lokal und self-hosted gedacht

- Dokumentiert und auditierbar

- Aus eigener Runtime entwickelt

- Made in Austria