AI Agent Team aufbauen

Grundlagen · 6 min

Ein AI-Agent Team besteht aus spezialisierten Agenten (ReAct, Tool, Planner, Critic) die zusammenarbeiten. Jeder Agent hat Memory, Tools, Persona und Guardrails. Starte mit einem Agent, dann erweitere.

Ein AI-Agent ist nicht genug. Du brauchst ein Team — spezialisierte Agenten, die zusammenarbeiten.

Was ist ein AI Agent?

Wenn die meisten Leute an KI denken, denken sie an Chatbots: Du tippst eine Frage ein, die KI antwortet, die Konversation endet und die KI vergisst alles. Das ist Single-Shot-Interaktion — nützlich, aber begrenzt.

Ein KI-Agent ist etwas anderes. Ein Agent ist ein KI-System, das kontinuierlich läuft, auf Aufgaben wartet, sie eigenständig ausführt und Ergebnisse meldet — ohne dass du jede Interaktion anstossen musst. Statt dass du zur KI gehst, kommt die KI zu dir.

Denk an den Unterschied zwischen einem Werkzeug und einem Mitarbeiter. Ein Hammer ist ein Werkzeug — du nimmst ihn, benutzt ihn, legst ihn weg. Ein Mitarbeiter kommt jeden Tag, erledigt Arbeit eigenständig und eskaliert nur wenn nötig. KI-Agenten sind näher am Mitarbeiter als am Werkzeug.

Ein AI-Agent ist ein Programm, das:

- Selbstständig plant

- Werkzeuge nutzt

- Entscheidungen trifft

- Feedback verarbeitet

Warum Multi-Agent statt Einzelagent?

Ein einzelner Agent, der alles macht — Coding, Content, Recherche, Testing, Monitoring — ist wie ein Mitarbeiter, der gleichzeitig Entwickler, Texter, QA-Tester und Systemadministrator ist. Im Kleinen funktioniert das, aber die Qualität sinkt mit wachsendem Aufgabenbereich. Multi-Agent Teams lösen das durch Spezialisierung:

- Bessere Output-Qualität: Ein fokussierter Agent liefert bessere Ergebnisse als ein Generalist. Sein Kontext wird nicht durch irrelevante Anweisungen verwässert.

- Parallele Ausführung: Mehrere Agenten können gleichzeitig an verschiedenen Aufgaben arbeiten — Code, Blogpost und Tests laufen parallel statt nacheinander.

- Klare Verantwortlichkeit: Wenn etwas schiefgeht, weisst du welcher Agent es bearbeitet hat. Debugging ist einfacher.

- Sicherheit durch Trennung: Der Research Agent kann Dateien lesen aber nicht ändern. Der Content Agent kann Posts entwerfen aber nicht veröffentlichen.

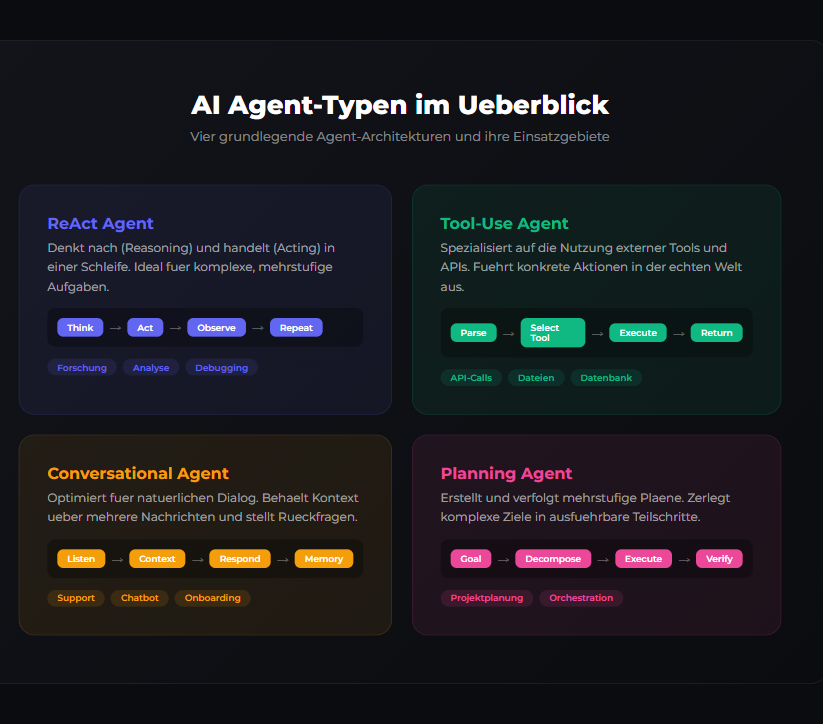

Arten von Agenten

| Typ | Beschreibung |

|---|---|

| ReAct Agent | Reasoning + Action |

| Tool Agent | Nutzt externe Tools |

| Planner Agent | Zerlegt Aufgaben |

| Critic Agent | Prüft Outputs |

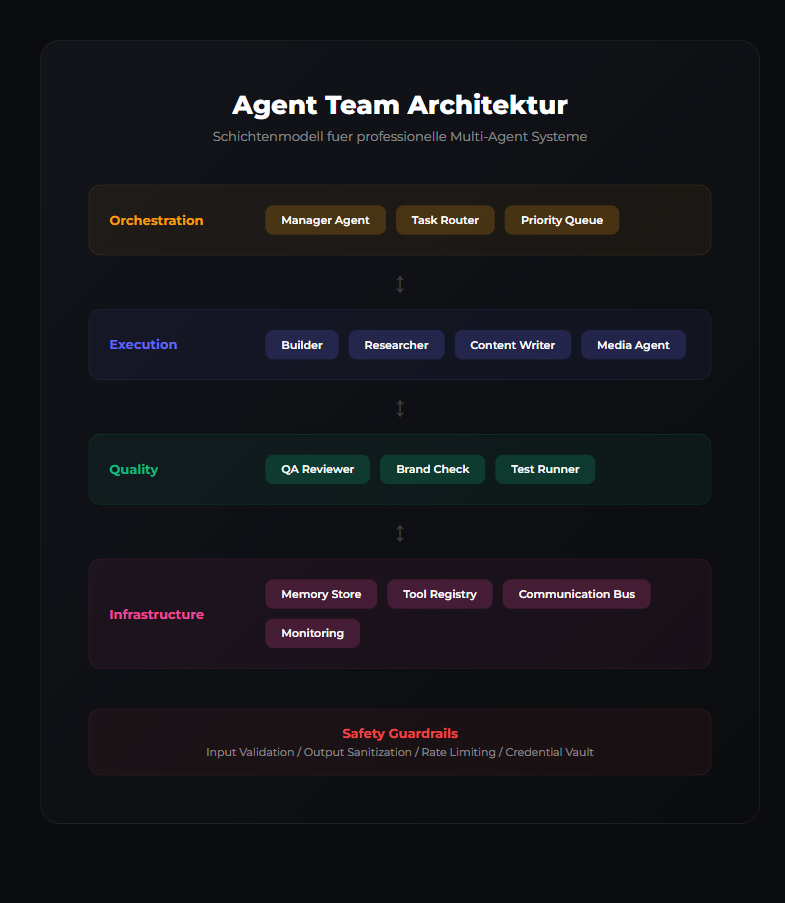

Team-Struktur

# Unser Team

Manager (Planner)

→ Developer (Code schreiben)

→ Tester (Prüfen)

→ Researcher (Recherche)

→ Deployer (Verteilen)Wichtige Komponenten

- Memory: Kontext zwischen Sessions

- Tools: Was der Agent tun kann

- Persona: Persönlichkeit, Regeln

- Guardrails: Grenzen, was er nicht darf

Tools-Integration

Unsere Agenten können:

- Code schreiben und ausführen

- Git-Operationen

- Docker Commands

- Dateien lesen/schreiben

- Web recherchieren

- Nachrichten posten (Team-Chat)

Ohne Guardrails kann ein Agent destruktive Aktionen ausführen — Dateien löschen, falsche Deployments machen, Credentials leaken. Definiere klare Grenzen was ein Agent NICHT darf, bevor du ihm Tools gibst.

Safety Rules aus echten Vorfällen

Ein autonomes Agent-Team zu betreiben lehrt harte Lektionen. Diese Regeln stammen aus echten Vorfällen:

- Keine destruktiven Befehle ohne menschliche Bestätigung. Ein Agent hat einmal drei Stunden Arbeit gelöscht weil eine Aufgabenbeschreibung mehrdeutig war.

- Agenten dürfen sich nie gegenseitig imitieren. Jeder Agent muss seinen eigenen Bot Token verwenden. Cross-Posting bricht den Audit Trail.

- Shared Memory Files nie überschreiben. Immer anhängen oder spezifische Abschnitte bearbeiten, nie die ganze Datei ersetzen.

- Ankündigen bevor man an Shared Resources arbeitet. Wenn zwei Agenten gleichzeitig die gleiche Datei ändern, werden die Änderungen eines Agenten überschrieben.

Wie Agenten kommunizieren

In der Praxis kommunizieren Agenten über Team-Chat-Kanäle (z.B. Team-Chat). Jeder Agent hat seinen eigenen Bot-Account. Aufgaben kommen über den Hauptkanal herein, der Manager delegiert, und der zugewiesene Agent postet das Ergebnis. Diese kanalbasierte Kommunikation erzeugt einen transparenten Audit Trail — du kannst genau nachvollziehen, wer was gemacht hat und wann.

Start

Beginne mit einem Agenten. Dann erweitere — je nach Bedarf. Starte mit dem Manager/Orchestrator, füge dann Worker hinzu wenn das Aufgabenvolumen wächst.

Quellen

- Anthropic: Agent Patterns — ReAct, Tool Use, Orchestration

- ReAct: Synergizing Reasoning and Acting — Original Paper

- Anthropic: Tool Use — Function Calling Dokumentation

War dieser Artikel hilfreich?

Nächster Schritt: vom Wissen in die Umsetzung

Wenn du mehr willst als Theorie: Setups, Workflows und Vorlagen aus dem echten Betrieb für Teams, die lokale und dokumentierte AI-Systeme wollen.

- Lokal und self-hosted gedacht

- Dokumentiert und auditierbar

- Aus eigener Runtime entwickelt

- Made in Austria