30-Tage Local AI-Stack Quickstart

Grundlagen · 8 min

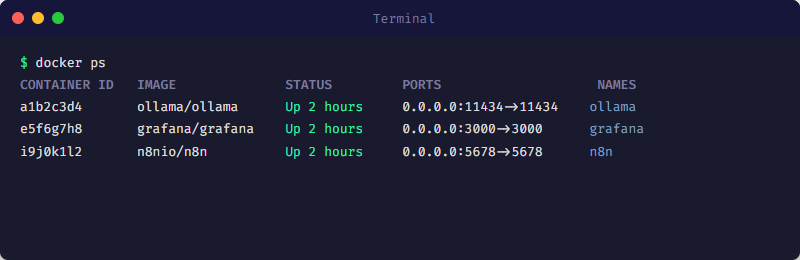

In 30 Tagen von Null zum produktiven, DSGVO-konformen AI-Stack. Phase 1: Docker + Netzwerk (Tag 1-7). Phase 2: Ollama + LLMs (Tag 8-14). Phase 3: n8n Automatisierung (Tag 15-21). Phase 4: Monitoring + Security + Backup (Tag 22-30).

Du willst einen lokalen AI-Stack aufbauen? Diese Tag-für-Tag Anleitung zeigt dir, wie du in 30 Tagen von Null zu einem produktiven, DSGVO-konformen Stack kommst.

Was du am Ende hast

- Docker Swarm Cluster (3 Nodes)

- Ollama mit lokalen LLMs (Llama 3, Mistral)

- n8n Workflow-Automatisierung

- Monitoring mit Prometheus + Grafana

- 100% DSGVO-konform

Phase 1: Foundation (Tag 1-7)

Tag 1: Hardware-Check

- Minimum: 8GB RAM, 4 CPU-Kerne

- Empfohlen: 32GB RAM, 8+ CPU, GPU (RTX 3060+)

- Ubuntu 22.04 LTS installieren

Tag 2: Docker Installation

curl -fsSL https://get.docker.com | sh

sudo usermod -aG docker $USER

docker --versionTag 3: Netzwerk und Security

- UFW Firewall aktivieren

- SSH-Hardening (Key-Auth, Fail2Ban)

- Backup-Lösung planen

Tag 4-5: Docker Compose

- docker-compose.yml erstellen

- Erste Services starten (Traefik)

- Container-Management lernen

Tag 6-7: Dokumentation

- README.md erstellen

- Architektur-Diagramm

- Zugangsdaten in Passwort-Manager

Phase 2: AI Core (Tag 8-14)

Tag 8-9: Ollama

curl -fsSL https://ollama.com/install.sh | sh

ollama pull llama3:8b

ollama pull mistralTag 10-11: Modell-Auswahl

| Use-Case | Modell | RAM |

|---|---|---|

| Chat/Q&A | Llama 3 8B | ~16GB |

| Code | CodeLlama | ~16GB |

| Embedding | Nomic-embed-text | ~4GB |

| Maximum Quality | Llama 3 70B | ~140GB |

Tag 12-13: Chat Interface

Open WebUI oder Alternative installieren

Tag 14: RAG (optional)

ChromaDB oder Qdrant für Dokumenten-Suche

Phase 3: Automation (Tag 15-21)

Tag 15-16: n8n Installation

services:

n8n:

image: n8nio/n8n:latest

ports:

- "5678:5678"Tag 17-18: AI-Workflows

- Ollama-Node in n8n konfigurieren

- Ersten AI-Workflow erstellen

- Test mit Produktionsdaten

Tag 19-20: Eigene Workflows

- E-Mail-Antworten mit AI

- Dokumenten-Zusammenfassung

- Support-Ticket-Kategorisierung

Phase 4: Production (Tag 22-30)

Tag 22-23: Monitoring

- Prometheus + Grafana installieren

- Grundlegende Dashboards

Tag 24-25: Alerting

- Prometheus Alert Rules

- Benachrichtigungen (E-Mail, Slack)

Tag 26-27: Security Hardening

- API-Keys in Umgebungsvariablen

- Rate Limiting

- Regelmäßige Updates

Tag 28-29: Backup und Recovery

- Backup-Skript erstellen

- Automatisierte Backups (cron)

- Recovery-Prozedur dokumentieren

Tag 30: Review

- Vollständige Dokumentation

- Monitoring optimieren

- Runbook erstellen

Ein gebrauchter Mini-Server mit 32 GB RAM und einer gebrauchten RTX 3090 (ab ca. 750 Euro) reicht für die meisten lokalen AI-Workloads. Für den Einstieg tut es auch ein Desktop-PC mit 16 GB RAM.

Quellen

- Ollama — Lokale LLMs

- Docker: Get Started — Offizielle Docker-Anleitung

- n8n.io — Workflow-Automatisierung

- Grafana — Monitoring und Dashboards

Weiterfuehrende Artikel: AI Stack Setup · Ollama Tutorial · Docker Grundlagen

Fuer die Umsetzung gibt es Ressourcen auf ai-engineering.at.

War dieser Artikel hilfreich?

Nächster Schritt: vom Wissen in die Umsetzung

Wenn du mehr willst als Theorie: Setups, Workflows und Vorlagen aus dem echten Betrieb für Teams, die lokale und dokumentierte AI-Systeme wollen.

- Lokal und self-hosted gedacht

- Dokumentiert und auditierbar

- Aus eigener Runtime entwickelt

- Made in Austria